今天凌晨5點,OpenAI聯合創始人兼首席執行官SamAltman在其個人博客,發布了一篇深度文章《Three Observations》。

主要對AI世界提出了3點觀察,AI模型的智能水平大致等於用於訓練和運行它的資源的對數;

使用特定水平AI的成本大約每12個月下降10倍,而更低的價格會帶來更多的使用;線性增長的智能所創造的社會經濟價值是超指數增長。

文中還特意強調,OpenAI正在全力佈局AI Agent,這些成千上萬的智能體最終會被廣泛使用,成為各種業務場景中的虛擬同事。初級Agent的性能可能會差一些,但他們仍然會滲透到各個領域重塑世界經濟。

以下是原內容:

我們的使命是確保通用AI(AGI)能夠惠及全人類。

開始指向 AGI 的系統已經初現端倪,因此我們覺得有必要理解我們所處的這個時刻。AGI 是一個定義較為模糊的術語,但一般來說,我們將其定義為能夠在衆多領域以人類水平解決日益複雜問題的系統。

人類是工具製造者,天生具有探索和創造的內在動力,這種動力使得世界變得越來越好。每一代人都在前人的發現基礎上不斷進步,創造出更強大的工具——電力、晶體管、計算機、互聯網,以及即將出現的 AGI。

從某種意義上說,AGI 只不過是人類共同構建的進步階梯中的又一個工具。但從另一種意義上說,AGI 的出現標誌着一個全新的開始,很難不讓人覺得「這次真的不一樣了」。我們面前的經濟增長看起來令人驚歎,我們甚至可以想象一個能夠治癒所有疾病、讓人們有更多時間與家人相處、並充分發揮創造力的世界。

或許在十年內,地球上每個人的能力都將超過今天最具影響力的人。

我們繼續見證着AI開發的快速進步。以下是關於AI經濟學的三個觀察:

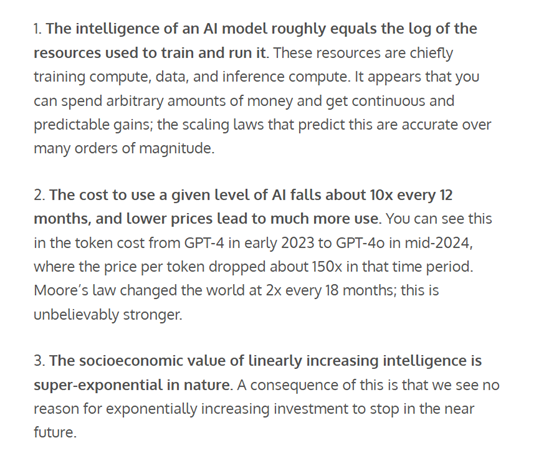

1、AI模型的智能水平大致等於用於訓練和運行它的資源的對數。這些資源主要包括訓練計算能力、數據和推理計算能力。似乎只要你願意投入任意數量的資金,就可以獲得持續且可預測的收益。預測這種收益的規模定律在多個數量級上都是準確的。

2、使用特定水平AI的成本大約每12個月下降10倍,而更低的價格會帶來更多的使用。你可以從2023年初的 GPT-4 到2024年中期的 GPT-4o 的token成本變化中看到這一點,在這一年半的時間裏,每token的價格下降了大約150倍。

摩爾定律每18個月使性能翻倍,從而改變了世界;而AI的成本下降速度比這還要令人難以置信。

3、線性增長的智能所創造的社會經濟價值是超指數增長的。這一結果表明,我們看不到指數級增長的投資會在近期停止的理由。

如果這三個觀察持續成立,其對社會的影響將是巨大的。

我們現在開始推出AI Agent,這些Agent最終會像虛擬同事一樣被廣泛使用。

讓我們以軟件工程Agent為例,這種Agent是我們認為特別重要的。想象一下,這種Agent最終能夠完成大多數有幾年經驗的頂級公司軟件工程師能夠完成的任務(最長可達幾天的任務)。它可能不會產生最大的新想法,需要大量的人類監督和指導,並且在某些方面表現出色,而在其他方面則可能表現不佳。

但仍然可以將其想象成一個真實但相對初級的虛擬同事。現在想象一下有1000個這樣的Agent。或者100萬個。再想象一下在每一個知識工作的領域都有這樣的Agent。

從某種意義上說,AI可能在經濟上類似於晶體管——一個可大規模擴展的重大科學發現,滲透到經濟的各個角落。我們不會過多地關注晶體管或晶體管公司,但我們會期待我們的電腦、電視、汽車、玩具等能夠發揮奇蹟般的作用。

世界不會一夜之間改變,它從未如此。短期內,生活仍將大致相同,2025年的人們仍將像2024年一樣度過大部分時間。我們仍然會墜入愛河、組建家庭、在網上爭吵、徒步旅行等。

但未來將以一種無法忽視的方式向我們襲來,社會和經濟的長期變化將是巨大的。我們將找到新的事情去做、新的方式互相幫助以及新的競爭方式,但這些可能與今天的工作大不相同。

自主性、意願和決心可能會變得極為重要。正確決定做什麼以及如何在不斷變化的世界中導航將具有巨大價值;韌性和適應性將是值得培養的技能。AGI將是人類意願的最強槓桿,它將使個人能夠比以往任何時候都產生更大的影響,而不是更小。

我們預計AGI的影響將是不均衡的。儘管某些行業可能變化不大,但科學進步可能會比今天更快,AGI的這一影響可能會超過其他一切。

許多商品的價格最終可能會大幅下降(目前,智力成本和能源成本限制了許多事情),而奢侈品和一些固有有限資源(如土地)的價格可能會更戲劇性地上升。

從技術角度來看,未來的道路似乎相當清晰。但公共政策和集體意見在如何將AGI融入社會方面至關重要。我們提前推出產品的一個原因是讓社會和技術有時間共同進化。

AI將滲透到經濟和社會的各個領域,我們期望一切都能變得智能。許多人期望需要給予人們比歷史上更多的對技術的控制權,包括更多地開源,並接受安全與個人賦權之間需要權衡的事實。

雖然我們永遠不想魯莽行事,而且可能會有一些與AGI安全相關的重大決策和限制措施會不受歡迎,但從方向上來說,隨着我們越來越接近實現AGI,我們相信傾向於更多地賦予個人權力是重要的。我們能看到的另一條可能的道路是,AI被威權政府用來通過大規模監控和剝奪自主權來控制其人口。

確保AGI的利益廣泛分配至關重要。技術進步的歷史影響表明,我們關心的大多數指標(健康結果、經濟繁榮等)在平均和長期來看會變得更好,但增加平等似乎並非由技術決定,正確地實現這一點可能需要新的想法。

特別是,資本與勞動之間的權力平衡可能會被打破,這可能需要早期干預。我們對一些聽起來很奇特的想法持開放態度,比如給地球上每個人分配一定的「計算預算」,以便他們能夠使用大量的AI,但我們也能看到通過不斷降低智力成本來實現期望效果的許多方法。

到2035年,任何人都應該能夠調用相當於2025年所有人智力總和的智力能力;每個人都應該能夠獲得無限的智慧,以他們能夠想象的任何方式加以利用。如今,世界上有許多人纔沒有足夠的資源來充分展現自己,如果我們能夠改變這一點,世界將創造出巨大的價值,從而為我們所有人帶來巨大的好處。

本文素材來源Sam Altman,如有侵權請聯繫刪除