段永平宣佈:我準備買英偉達了,AI值得關注,英偉達很不錯(附英偉達分析師會議記錄)

炒股就看金麒麟分析師研報,權威,專業,及時,全面,助您挖掘潛力主題機會!

在糾結了一段時間看不懂英偉達未來十年的競爭力之後,投資家段永平還是決定嘗試性買入了。

在英偉達發佈2024年四季度財報之後,段永平今早在雪球網表示:“儘管沒完全看懂NVDA(英偉達),但我還是準備開始賣點NVDA的put了。AI值得關注,NVDA其實是個很不錯的公司。”

稍早前,美東時間2月26日盤後,英偉達發佈了2025財年第四季度財報(截至2025年1月26日),成績超過華爾街預期。

財報顯示,英偉達第四財季總營收達到393.31億美元,同比增長78%;淨利潤爲220.66億美元,同比增長72%。全年來看,英偉達全年實現營收1304.97億美元,同比增長114%;淨利潤達728.80億美元,同比增長145%。

英偉達掌門黃仁勳在財報中表示,市場對Blackwell芯片的需求令人驚歎,因爲推理AI增加了另一種擴展法則——增加訓練的計算能力使模型更智能,而長時間思考的額外算力使答案更智能。

公司成功地大規模推進了Blackwell AI超級計算機的生產,在其首個季度實現了數十億美元的銷售額。隨着代理AI和物理AI爲下一波AI的到來鋪平道路,AI正以光速發展,並有望徹底改變最大型的行業。

2月26日收盤後,英偉達股價上漲3.67%,報收131.28美元/股,市值3.22萬億美元。

段永平所說的賣出put,表達的是對英偉達股票價格不會大幅下跌的預期。

所謂賣出put,Put的賣方一旦收取買方支付的權利金,就必須承諾:如果買方選擇行權(在到期日或之前),你需按執行價買入標的股票。

我們先來看段永平的觀點,再來看當晚英偉達分析師會議的內容,最後再請DS用通俗的語言,科普一下美股賣出PUT的含義。

提醒一下,本文的初衷只是瞭解一下行業和未來,絕對不是推薦股票,沒有獨立思考能力的人勿入!

一、段永平談英偉達

段永平:NVDA很難看懂的並不是短期的增長,而是長期的護城河到底是什麼。10年後的NVDA肯定還在,但還是目前的市場地位嗎?

評論區:能不能解釋得再細一點,段總?是以會有更強的競爭對手比如amd,國產gpu?還是說以後核顯越來越強,私人家用足以,分搶走一部分獨顯市場?還是說ds出現,顯卡算力市場並不需要那麼大?

段永平: 我沒啥可解釋的。我說的是我看不懂。未來算力的需求肯定是會繼續增長的,算力的供應包括DS(deepseek)這種效率提高,也大概率是會繼續增長的。

NVDA目前的毛利率巨高,因爲各大廠都不敢不買算力。同時,各有錢的大廠肯定是不心甘一直這麼高的價錢去買算力的。

這麼多有錢的企業,搞個三五年難道還不能搞出點名堂來?總感覺NVDA的MOAT(護城河)不是那麼牢不可破,但這確實不是我能力圈內的東西。

段永平: 我知道目前NVDA的護城河是CUDA,也知道CUDA的生態有點像蘋果。

(注:CUDA是 NVIDIA 發明的一種並行計算平臺和編程模型,它通過利用圖形處理器 (GPU) 的處理能力,可大幅提升計算性能。)

我也早就看到黃(仁勳)說的,目前別的芯片白給都比NVDA提供的方案貴,也看到黃說的10年後算力會是百萬倍的增長。但10年後就不能有別的替代方案嗎?

特別說明一下,我在這裏不是表示質疑NVDA,而是表示對NVDA有興趣,想努力看看能不能看懂,NVDA到底是不是可以成爲我的投資標的。

我其實跟很多業內人士聊過,甚至當面還聽蘇姐說過幾句,但到目前爲止依然一頭霧水。看不懂10年真的很難下手。

段永平:跌到137倍pe?大概率還早着呢!

評論區:deepseek不是衝擊力算力問題,而是支持非cuda生態的其它廠商芯片。

段永平:這個是關鍵!但我沒看懂是不是真是那麼回事。

評論區:傳說中的量子計算會不會是一個顛覆性技術?

段永平:沒有什麼比可控核聚變厲害的了。

段永平::儘管沒完全看懂NVDA,但我還是準備開始賣點NVDA的put了。ai值得關注,NVDA其實是個很不錯的公司。

評論區:你賣put我來買,泡沫已經太明顯。

段永平:你拉倒吧!

評論區:英偉達火了兩年,很好奇爲什麼大道在這個時點關注?特別DS出來後對算力的爭議巨大,大道是看見了什麼?

段永平:我關注很久了!

二,英偉達分析師會議問答記錄

(手工記錄,或不準確,請以官方最終發佈爲準)

Blackwell通用,客戶需求驚人

Q1:Jensen(注:英偉達創始人黃仁勳的英文名),既然測試計算和強化學習展現出瞭如此巨大的潛力,我們顯然能看到,訓練和推理之間的界限正日益模糊。

這對於未來專門用於推理的集羣的潛在發展意味着什麼?你認爲,這對英偉達公司及其客戶的整體影響是怎樣的呢?

黃仁勳:我明白你的意思,傑伊。現在存在多種規模擴展方面的損耗情況。

首先是預訓練的規模擴展規律,而且這種擴展還會持續下去,因爲我們有了多模態數據,並且有了來自推理的數據,這些數據現在正被用於進行預訓練。

其次是後訓練階段的規模擴展,通過使用強化學習結合人類反饋、強化學習結合人工智能反饋、強化學習以及可驗證的獎勵機制,實際上在後訓練階段所使用的計算量比預訓練階段還要高。

從某種意義上來說,這是合理的,因爲當你使用強化學習時,可以生成大量的合成數據或者合成生成的標記,

人工智能模型本質上就是在生成標記來訓練自身模型,這就是後訓練階段的情況。

第三點,也就是你提到的部分,是測試階段的計算或者說推理、深度思考以及新的規模擴展方式。它們本質上都是相似的概念。

在這個過程中,你會有一連串的思路,你會進行搜索。所生成的標記數量以及及所需的推理計算量,已經比早期大語言模型僅進行單次示例和單次處理能力時高出了100倍。而這僅僅只是個開始,這纔剛剛起步。

未來,下一代模型有可能會達到數千倍的提升,甚至我們希望,那些基於深度思考、模擬和搜索的模型,其計算量可能會比現在高出數十萬倍乃至數百萬倍。

問題就在於,你要如何設計這樣的架構呢?有些模型是自迴歸模型,有些模型是基於擴散模型的。有時候,你希望數據中心具備分散式推理的能力,有時候又希望它是集中式的。

因此,很難確定數據中心的最佳配置是什麼,這也正是英偉達的架構如此受歡迎的原因。我們能運行各種模型,我們擅長訓練。實際上,如今我們的計算量中絕大部分都用於推理,而Blackwell(產品)將這一切提升到了一個新的水平。

我們在設計Blackwell時,就考慮到了推理模型的需求。當你看訓練方面時,它的性能要高出許多倍。

但真正令人驚歎的是,對於需要深度思考的測試階段規模擴展推理人工智能模型來說,它的速度要快上數十倍,吞吐量能提高25倍。所以,Blackwel在各個方面都將表現得非常出色。

當你擁有一個數據中心,它能讓你根據當前是在進行更多的預訓練、後訓練還是擴展推理能力來配置和使用數據中心時,我們的架構是通用的,並且很容易以各種不同的方式來使用。

事實上,我們看到,現在比以往任何時候都更傾向於採用統一的架構。

Q2:您是否可以談談在國際消費電子展(CES)上提到的GB200,您當時提到了機架級系統的複雜性以及面臨的挑戰。然後,正如您在事先準備好的發言中所說,我們已經看到GB200在很大程度上實現了通用可用狀態。

那麼,在擴大生產規模方面,目前進展到什麼程度?除了芯片層面的問題,在系統層面上是否仍然存在需要考慮的瓶頸?您對 NVL72 平臺是否依然保持着熱情?

黃仁勳:對GB200的熱情,比在國際消費電子展(CES)時還要高。

原因在於,自國際消費電子展以來,我們已經出貨了更多產品。我們有大約350家工廠。這些工廠負責製造用於每個Blackwell機架(即 Grace Blackwell 機架)的150萬個組件。

沒錯,這極其複雜。而我們成功且出色地擴大了Grace Blackwell 的生產規模,上個季度實現了約110億美元的營收。由於需求相當高,客戶急切且迫不及待地想要拿到他們的Blackwel系統,我們將不得不繼續擴大生產規模。

你可能在網上看到過,有不少關於GraceBlackwell系統上線的慶祝消息,當然我們也有相關慶祝活動。我們爲自己的工程團隊、設計團隊和軟件團隊安裝了相當數量的GraceBlackwell系統。

Core Weave 公司如今已經相當公開地宣佈他們成功啓用了該系統。當然,微軟、OpenAl也都用上了,而且你開始看到越來越多的系統上線。

所以,我認爲,對於你的問題答案是:我們所做的事情沒有一件是容易的,但我們進展得很順利,我們所有的合作伙伴也都進展順利。

Blackwell毛利率超過70%,還將提升

Q3:科萊特(注:英偉達執行副總裁兼首席財務官),如果你不介意的話,能否確認一下第一季度是否就是毛利率的最低點呢?然後,詹森,我的問題是問你的。在你的(業務監控)儀表盤上有哪些指標讓你有信心認爲這種強勁的需求能夠持續到明年呢?還有,DeepSeek公司以及他們所推出的任何創新成果,有沒有在任何方面改變你對這種情況的看法呢?

科萊特:讓我先來回答問題中關於毛利率的第一部分內容。

在我們擴大Blackwell產品的生產規模期間,毛利率將處於70%出頭的水平。目前,我們正專注於加快生產速度,以確保能夠儘快向客戶供貨。

我們的Blackwell產品正在全面推進量產。哦,抱歉,一旦我們的Blackwell產品全面實現量產,我們就能夠降低成本並提高毛利率。所以,我們預計今年晚些時候毛利率可能會達到70%中期的水平。

就像你聽到詹森談到的那些系統及其複雜性,在某些情況下,這些系統是可定製的。它們有多種網絡配置選項,還具備液冷和水冷功能。所以我們知道,未來我們有機會提高這些產品的毛利率。但目前,我們將專注於加快生產(此處有聽不清的內容),並儘快把產品交付給客戶。

黃仁勳:我們清楚一些情況,對於數據中心正在進行的資本投資規模,我們有相當清晰的預期。我們知道,未來絕大多數軟件都將基於機器學習。因此,在數據中心中,你會希望採用加速計算、生成式人工智能以及推理式人工智能這類架構。

當然,我們有來自頂級合作伙伴的預測和規劃。而且我們也明白,仍有許多極具創新性、令人興奮的初創企業正在崛起,它們是推動人工智能領域實現下一個重大突破的新機遇,無論是智能體人工智能、推理式人工智能還是物理人工智能--初創企業的數量仍然相當可觀,並且它們中的每一家都需要大量的計算基礎設施。

我認爲,無論是短期信號還是中期信號,短期信號當然包括採購訂單和預測之類的東西。中期信號則是與前幾年相比基礎設施的水平以及資本支出的擴張規模。

而長期信號則基於這樣一個事實,即我們從根本上瞭解到,軟件已經從在中央處理器(CPU)上運行的手工編碼,轉變爲在圖形處理器(GPU)和加速計算系統上運行的基於機器學習和人工智能的軟件,

因此,我們相當清楚這就是軟件的未來。當你進一步思考時,換個角度來看,我們實際上只是觸及了消費級人工智能、搜索領域以及一定程度的消費級生成式人工智能、廣告和推薦系統等,這些還只是軟件發展的早期階段。

下一波浪潮即將到來,包括面向企業的智能體人工智能、用於機器人技術的物理人工智能,以及隨着不同地區爲自身生態系統構建人工智能而出現的主權人工智能。

而這些領域幾乎都纔剛剛起步,並且我們能夠預見到它們的發展。我們能夠預見到,是因爲顯然我們處於這些發展的核心位置,我們能看到在所有這些不同領域都在發生着巨大的活動,而且這些都會成爲現實。所以,無論是短期、中期還是長期,都是如此。

Blackwell Ultra產品將在下半年推出

可以順利銜接Blackwell產品

Q4:你們的下一代Blackwell Ultra產品預計將於今年下半年推出,這與團隊的年度產品發佈節奏相符。詹森,鑑於你們目前仍在擴大現有一代Blackwel 解決方案的生產規模,你能否幫我們瞭解一下市場對Blackwell Ultra產品的需求動態呢?你們的客戶和供應鏈又將如何同時應對這兩款產品的生產規模擴大呢?

另外,團隊在今年下半年推出Blackwell Ultra產品的計劃是否仍按原計劃推進?

黃仁勳:是的。Blackwell Ultra產品將在下半年推出。

如你所知,第一代Blackwell產品推出時我們遇到了一點小波折,這可能讓我們延誤了幾個月的時間。當然,我們已經完全恢復了。

團隊在恢復生產方面做得非常出色,我們所有的供應鏈合作伙伴以及衆多人士都以極快的速度幫助我們實現了恢復。所以現在我們已經成功擴大了Blackwell產品的生產規模。

但這並不會讓後續的產品計劃停滯。後續產品是按照年度節奏推進的,Blackwell Utra產品將配備新的網絡技術、新的內存,當然還有新的處理器,所有這些都將投入使用。

我們一直在與所有的合作伙伴和客戶共同努力,規劃相關事宜。他們已經掌握了所有必要的信息,我們會與所有人合作,做好恰當的過渡工作。

這次從Blackwell產品過渡到Blackwell Ultra產品,系統架構完全相同。從Hopper產品過渡到Blackwel產品時難度要大得多,因爲我們從NVLink 8系統過渡到了基於NDLINK72的系統。所以機箱、系統架構、硬件以及供電系統等所有方面都必須做出改變。這是一次相當具有挑戰性的過渡。

但下一次過渡,Blackwell Ultra產品會很順利地銜接上。我們也已經透露了後續的產品信息,並且一直與所有合作伙伴就之後的產品進行緊密合作。

之後的產品叫做Vera Rubin,我們所有的合作伙伴都在加快了解這款產品的過渡情況,併爲此做準備。而且,我們又將帶來一次巨大的提升。

所以,來參加GPU技術大會(GTC)吧,我會和你們聊聊Blackwell Ultra和Vera Rubin產品,然後向你們展示我們在這之後的規劃。會有非常令人興奮的新產品,所以一定要來參加GTC大會。

Q5:我們聽說了很多關於定製專用集成電路(ASIC)的事情。你能談談客戶定製 ASIC 和商用圖形處理單元(GPU)之間的平衡問題嗎?

我們聽說了一些使用GPU和ASIC的異構超級集羣,這是客戶計劃構建的嗎?還是說這些基礎設施仍會保持相當的獨立性?

黃仁勳:我們所打造的產品與專用集成電路(ASIC)有很大不同,在某些方面甚至截然不同,不過在一些領域也有交集。我們在幾個方面存在差異。

首先,英偉達(NV)的架構具有通用性,無論你是針對非激進型模型、基於擴散的模型、基於視覺的模型,還是多模態文本模型進行優化,我們的架構在所有這些方面都表現出色。

我們在各個方面都表現卓越,因爲我們的軟件堆棧非常出色--我們的架構設計合理,軟件堆棧生態系統極爲豐富,以至於我們成爲了大多數令人興奮的創新和算法的初始目標。

從定義上來說,我們的通用性遠遠超過了專用性。從端到端的流程來看,我們也非常出色,從數據處理、訓練數據的管理,到數據訓練,當然還包括後訓練中使用的強化學習,一直到在嚴格的時間尺度下進行推理,我們都遊刃有餘。

我們具有通用性,能實現端到端的處理,並且應用廣泛。因爲我們不侷限於某一個雲平臺,而是存在於所有云平臺中,我們也可以在本地部署,甚至可以應用於機器人中。我們的架構更容易獲取對於任何新成立的公司來說,都是絕佳的初始目標。所以我們無處不在。

我要說的第三點是,我們的性能提升節奏非常快。要記住,這些數據中心的規模往往是固定的,或者其功率是固定的。如果我們的每瓦性能達到2倍、4倍甚至8倍(這並不罕見),這將直接轉化爲收入。

所以,如果你有一個100兆瓦的大型數據中心,如果在這個100兆瓦的數據中心裏,性能或吞吐量提高了4倍或8倍,那麼這個數據中心的收入也會相應提高8倍。

這與過去的數據中心如此不同的原因在於,人工智能工廠可以通過生成的標記直接實現貨幣化。因此,我們架構的標記處理吞吐量如此之快,對於所有出於創收目的而構建這些設施並追求快速投資回報率的公司來說,具有極高的價值。所以我認爲第三個原因就是性能。

最後我想說的是,軟件堆棧的構建難度極大。打造一款專用集成電路(ASIC)和我們所做的事情並無不同。我們構建了一種新的架構,而如今基於我們架構之上的生態系統比兩年前複雜了10倍。

這一點相當明顯,因爲全球基於我們架構所開發的軟件數量正在呈指數級增長,而且人工智能的發展速度非常快,要在多個芯片之上構建起整個生態系統是很困難的。

所以我認爲有這四個原因。

最後,我還要說一點,僅僅設計出芯片並不意味着就能將其部署應用。這種情況屢見不鮮。有很多芯片被製造出來,但到了需要做決策的時候,就必須做出商業決策,而這個商業決策涉及到將一個新的引擎、新的處理器部署到規模、功率和成本都有限的人工智能工廠中。

而我們的技術不僅更加先進、性能更高,還具備更好的軟件能力,而且非常重要的是,我們的部署速度極快。大家現在都知道,這些優勢對於(在市場競爭中)脫穎而出已經足夠了。我們表現出色、能夠獲勝,是有很多不同原因的。

中國業務佔比與之前持平

Q6:你很清晰地解釋了需求背後的一些強勁因素。但是美國業務的營收環比增長了大約50億美元左右。人們可能擔心,如果對其他地區實施監管措施,美國業務是否能夠彌補可能出現的缺口。

我想知道,在這一整年裏,如果美國業務的這種增長勢頭持續下去,是否可行呢?而且如果美國業務的增長是你公司增長率的支撐,在業務結構向美國傾斜的情況下,你該如何保持如此快速的增長?

從業務指引來看,中國業務的營收可能會環比增長。你能否詳細闡述一下這種變化態勢,或許科萊特也可以發表一下看法。

黃仁勳:中國業務的佔比與第四季度以及之前幾個季度大致相同。目前的規模大約是實施出口管制之前的一半,但佔比大致保持不變。

關於地域方面,關鍵要點在於,人工智能是一種軟件,是現代軟件。它是令人驚歎的現代軟件,而且人工智能已經成爲主流。人工智能被廣泛應用於名地的配送服務、購物服務中。如果你訂購一份牛奶並配送到家,這其中就有人工智能的參與。

所以,幾乎所有消費者服務的中心,都有人工智能的存在。

每個學生都會把人工智能當作輔導老師,醫療保健服務使用人工智能,金融服務也使用人工智能。沒有哪家金融科技公司會不使用人工智能,實際上,每家金融科技公司都會用到。氣候科技公司使用人工智能,現在礦產勘探也用到了人工智能。

在高等教育領域,每一所大學都在使用人工智能所以可以很肯定地說,人工智能已經成爲主流,並且正被融入到每一種應用當中。

當然,我們希望這項技術能夠繼續安全地發展,並以對社會有益的方式進步。

基於此,我確實認爲,我們正處在這一全新轉型的開端。我所說的開端是指,要知道,在我們身後是幾十年來建成的數據中心和計算機,而它們是爲一個以手工編碼、通用計算以及中央處理器(CPU)等爲主的世界而構建的。

展望未來,可以很肯定地說,這個世界幾乎所有的軟件都將融入人工智能。所有的軟件和服務最終都將基於機器學習,數據飛飛輪將成爲改進軟件和服務的一部分,而且未來的計算機將是經過加速的,未來的計算機將基於人工智能。

我們實際上纔剛剛踏上這段旅程兩年時間,而要讓經過幾十年才建成的計算機實現現代化。所以我相當確定,我們正處於這個新時代的開端。

最後,從來沒有任何一項技術有機會像人工智能這樣,影響到全球國內生產總值(GDP)中如此大的比重,也沒有任何一款軟件工具能夠做到。

所以,現在人工智能作爲一種軟件工具,能夠影響到全球GDP中比歷史上任何時期都更大的比重。因此,我們思考增長的方式,以及判斷某事物規模大小的方式,都必須放在這樣的背景下來考量。

當你退一步,從這個角度來看待問題時,就會發現我們真的纔剛剛起步。

企業業務的增長更快

Q7:我有一個需要澄清的點和一個問題。先請科萊特來澄清一下。你是不是說,數據中心業務中的企業客戶部分,在1月所在的那個季度同比增長了兩倍?如果是這樣的話,這是否意味着它的增長速度比超大規模數據中心運營商還要快呢?

詹森,我有個問題想問你。超大規模數據中心運營商是你們解決方案的最大買家,但他們購買設備既用於內部工作負載,也用於外部工作負載,而外部工作流程指的是企業所使用的雲服務。

我的問題是,你能否讓我們瞭解一下,超大規模數據中心運營商的支出,在外部工作負載和內部工作負載之間是如何分配的?另外,隨着這些新的人工智能工作流程應用的出現,你評估,企業在消費組合中所佔的比例是否會變得更大?這又是否會影響到你們開發服務以及生態系統的方式呢?

科萊特:是的,企業業務實現了增長,而且增長情況與我們從大型雲服務提供商(CSP)那裏看到的情況非常相似。

請記住,瞭解與雲服務提供商的合作以及他們在大型語言模型方面的工作,還有他們在自身業務中進行推理的工作,這些都是很重要的方面。

但也要記住,這同樣也是企業業務所涉及的領域。企業既與雲服務提供商合作,也會自行構建相關業務。這兩方面的發展都相當不錯。

黃仁勳:雲服務提供商(CSP)的業務佔我們總業務的大約一半。而且正如你所說,雲服務提供商存在內部消費和外部消費。當然,我們的產品被用於他們的內部消費。

我們與所有云服務提供商都緊密合作,以優化他們內部的工作負載。因爲他們擁有大量可利用的英偉達設備基礎設施。而且我們的產品一方面可用於人工智能,另一方面可用於視頻處理,以及像Spark這樣的數據處理,具有通用性。

所以我們基礎設施的使用壽命要長得多。如果使用壽命更長,那麼總體擁有成本(TCO)也會更低。

第二個問題是我們如何看待企業(如果你願意,也可以說是非雲服務提供商的企業)未來的增長情況呢?我的答案是,從長遠來看,企業業務的增長規模要大得多。

原因在於,如果你審視當今的計算機行業,那些尚未被行業充分服務的領域在很大程度上是工業領域。

讓我舉個例子。當我們說到企業時,我們以汽車公司爲例,因爲汽車公司既生產軟件相關的產品,也生產硬件產品。

就拿汽車公司來說,公司的員工羣體就是我們所說的企業範疇,我們有智能體人工智能(ageneticAl)、軟件規劃系統和工具,而且我們在GPU技術大會(GTC)上會有一些非常令人興奮的成果與大家分享,我們構建智能體系統是爲了讓員工更高效地進行設計、制定市場計劃以及運營公司。這就是智能體人工智能。

另一方面,他們生產的汽車也需要人工智能。他們需要一個人工智能系統來訓練汽車,管理這一龐大的汽車車隊。

如今,道路上有10億輛汽車。未來某一天,道路上依然會有10億輛汽車,而且每一輛汽車都將是自動駕駛汽車,它們都會收集數據,並且我們會通過人工智能工廠來改進它們。

如今,他們有自己的工廠,未來他們將擁有一個汽車工廠和一個人工智能工廠,然後在汽車內部本身就是一個機器人系統。

所以,如你所見,這裏涉及到三種計算機。有一種計算機是幫助人們的。還有一種計算機是爲機械設備構建人工智能的,當然,這些機械設備可以是拖拉機、割草機。也可以是如今正在研發的人形機器人或其他機器人。還可以是建築物或倉庫,

這些物理系統需要一種新型的人工智能,我們稱之爲物理人工智能。它們不能僅僅理解單詞和語言的含義,還必須理解現實世界的意義、摩擦力和慣性、物體恆存性以及因果關係。

所有這些對我們來說是常識的東西,人工智能卻必須去學習這些物理效應。所以我們把這稱爲物理人工智能。

利用智能體人工智能來徹底改變我們在公司內部的工作方式,這一領域纔剛剛起步。現在正是智能體人工智能時代的開端,你也聽到很多人在談論這個話題,而且我們也取得了一些非常出色的進展。

在這之後是物理人工智能領域,再之後是機器人系統領域。所以這三種計算機都是全新的領域。

我的感覺是,從長遠來看,這無疑將是一個更大的市場,這也是有一定道理的。世界國內生產總值(GDP)主要由重工業、工業以及爲這些行業提供服務的公司所構成。

“不用擔心替換週期和毛利率”

Q8:如今,我們即將迎來2023年你所見證的Hopper 架構在通用生成式人工智能領域帶來的轉折的兩週年紀念。當我們思考你所規劃的未來路線圖時,從替換週期的角度來看,你如何看待已經部署的基礎設施呢?

另外,無論是GB300還是那個Rubin系列產品,我們是否開始看到一些設備更新換代的機會呢?你對這方面是怎麼看的?

黃仁勳:首先,人們仍在使用 Volta.Pascal和 Ampere 架構的產品。原因在於,由於CUDA的可編程性非常強,所以總會有一些應用場景。

目前, Blackwell的一個主要應用場景就是數據處理和數據整理。

假設你發現了一種情況,某個人工智能模型不太擅長處理SP58765061(可能是特定數據或任務標識?)相關的任務。

你將這種情況呈現給一個視覺語言模型,比如說,這是一個關於汽車的模型,這個視覺語言模型實際上會審視這種情況,並說,“這就是所發生的情況,而且我很擅長處理這個”。

然後,你把這個對提示的回應拿過去,促使另一個人工智能模型在你整個數據池中去尋找類似情況,不管那種情況具體是什麼。接着,你使用人工智能進行領域隨機化處理,並生成一大堆其他示例。然後基於這些,你就可以去訓練模型了。

所以,你可以使用安培架構的產品去進行數據處理、數據整理以及基於機器學習的搜索。然後你創建訓練數據集,再將其提供給 Hopper 架構系統用於訓練。

而且這些架構中的每一種都是完全… 它們都與CUDA 兼容,所以,所有東西都能相互配合使用。但是如果你已經部署了相關基礎設施,你就可以把那些強度較低的工作負載分配到過去已安裝的設備上,所有這些都能得到很好的利用。

Q9:我有一個關於毛利率的後續問題要問科萊特,我知道Blackwell產品的良率,以及以太網的組合情況等諸多因素都在變化。

你在之前回答問題時提到過,4月所在的季度是毛利率的最低點,但要達到你所說的本財年末毛利率處於70%中期水平的目標,下半年每個季度的毛利率就得提升大約 200個基點。而且我們對於關稅對更廣泛的半導體行業的影響仍知之甚少。那麼,是什麼讓你對今年下半年毛利率朝着這個預期走勢發展有信心呢?

科萊特:感謝提問。就我們在Blackwel 系統中所整合的材料及其他所有內容而言,我們的毛利率相當複雜,從長期來看,有大量機會從諸多不同方面來更好地提高我們的毛利率。

請記住,我們在布萊克威爾系統上還有許多不同的配置,這將有助於我們做到這一點。所以,在爲我們的客戶完成一些強勁的產能提升之後,我們就可以一起開展大量相關工作。如果不行的話,我們也會儘可能儘快開始。

如果我們能在短期內提升(毛利率),我們也會這麼做。

目前來說,關稅情況還不太明朗,在我們進一步瞭解美國政府的計劃,包括時間、地點和幅度之前,它都是個未知數。所以目前我們還在等待,但當然,我們始終會遵守出口管制和/或關稅規定。

三美股的賣出put的含義

關於美股的賣出put是什麼意思,deepseek是這麼回答小雅的:

小雅一問:美股的call和put是什麼意思?

ds回答:

在美股市場中,Call(看漲期權)和Put(看跌期權)是兩種基礎的期權合約,允許投資者在不直接持有股票的情況下押注價格波動或對沖風險。

以下是它們的核心概念和區別:

1. Call(看漲期權)

定義:

買方支付權利金後,有權在到期日或之前,以約定的執行價買入標的股票。賣方則有義務按此價格賣出股票。

適用場景:當投資者看漲某股票(如特斯拉、蘋果)時,可通過買入Call押注股價上漲。

收益與風險:

買方:風險有限(最大損失爲權利金),潛在收益無限(股價越高,盈利越大)。

賣方:收益有限(賺取權利金),但風險極高(若股價暴漲,需按低價賣出股票)。

舉例:

假設蘋果股價現爲150美元,你買入一份執行價160美元、1個月到期的Call,支付權利金5美元/股。

假設到期時,蘋果股價漲至180美元,你可按160美元買入並立即以市價賣出,賺取(180-160-5=15美元/股。

假設到期時,蘋果股價未超過160美元,你可以放棄行權,僅損失5美元權利金。

2. Put(看跌期權)

定義:買方支付權利金後,有權在到期日或之前,以執行價賣出標的股票。賣方必須按此價格買入。

適用場景:當投資者看跌某股票(如擔心財報暴雷)時,可通過買入Put對沖下跌風險或投機。

-收益與風險:

買方:風險有限(損失僅爲權利金),收益取決於股價跌幅(股價跌至0時,收益最大)。

賣方:收益固定(權利金),但若股價暴跌,需按高價接盤,可能鉅虧。

舉例:

假設特斯拉股價現爲200美元,你買入一份執行價180美元、1個月到期的Put,支付權利金7美元/股。

若到期時股價跌至150美元,你可按180美元賣出股票,賺取(180-150-7=23美元/股)。

若股價高於180美元,放棄行權,損失7美元權利金。

3. 關鍵術語對比

4. 期權價格的兩部分

內在價值:立即行權可獲得的利潤。

Call內在價值 = 當前股價 - 執行價(若股價>執行價,否則爲0)。

Put內在價值 = 執行價 - 當前股價(若執行價>股價,否則爲0)。

時間價值:權利金中超出內在價值的部分,反映股價未來波動的可能性。到期日越遠,時間價值越高。

5. 注意事項

美式 vs 歐式期權:美股期權多爲美式,可在到期前任何時間行權;歐式僅限到期日行權。

高槓杆風險:期權自帶槓桿,收益放大,但虧損也可能快速發生,尤其是賣方。

流動性:優先選擇交易量大、買賣價差小的期權合約,避免難以平倉。

總結:Call和Put是投資者應對市場波動的工具,Call用於押注上漲,Put用於防範下跌或做空。買方適合風險偏好較低者,賣方則需承受高風險以賺取權利金。建議新手從模擬交易開始,並深入學習希臘字母(Delta、Gamma等)以管理風險。

小雅二問:在美股,賣出put是什麼意思?

ds回答:

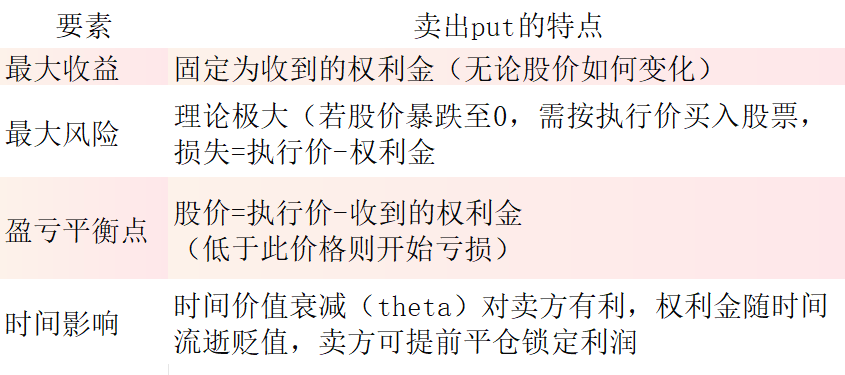

在美股市場中,賣出Put(做空看跌期權)是期權交易中一種常見的策略,通常用於賺取權利金收入或表達對標的股票價格不會大幅下跌的預期。

以下是其核心邏輯、風險和典型應用場景:

1. 賣出Put的定義

義務:作爲Put的賣方(義務方),你收取買方支付的權利金,但必須承諾:如果買方選擇行權(在到期日或之前),你需按執行價(Strike Price)買入標的股票。

市場預期:

認爲股價不會跌破執行價(中性或看漲);

或願意以執行價接盤股票(相當於“打折買入”)。

2. 收益與風險

3. 典型應用場景

場景1:賺取權利金(中性市場)

邏輯:認爲股價短期內會在執行價上方震盪,不會大幅下跌。通過賣出Put收取權利金,無需實際持有股票。

舉例:

當前特斯拉股價200美元,你賣出1份執行價180美元、1個月到期的Put,收取權利金7美元/股。

若到期股價≥180美元,買方放棄行權,你淨賺7美元/股。

若股價跌至170美元,你需按180美元買入股票,成本爲180 - 7 = 173美元/股(相當於以173美元接盤,低於市價170美元則虧損)。

場景2:低成本買入股票(看漲但等待回調)

邏輯:長期看好某股票,但希望以更低價格買入。賣出Put相當於設定一個“心理買入價”(執行價),若股價未跌至此價則白賺權利金;若跌至此價則按目標價買入。

舉例:

想以150美元買入蘋果股票(現價160美元),賣出執行價150美元的Put,收取權利金5美元/股。

若股價未跌破150美元,賺取5美元權利金;若跌破,則以150 - 5 = 145美元/股的實際成本買入股票。

場景3:對沖持倉風險(增強收益)

邏輯:持有股票時,賣出Put可額外賺取權利金(需注意風險疊加)。

4. 關鍵風險與注意事項

強制接盤風險:若股價暴跌,賣方必須按執行價買入股票,可能面臨鉅額虧損(尤其是高波動標的)。

保證金要求:賣出Put需賬戶有足夠保證金(券商可能要求凍結資金,限制流動性)。

流動性風險:冷門期權可能難以平倉,需持有到期。

心理壓力:股價逼近執行價時,需承受是否提前平倉的決策壓力。

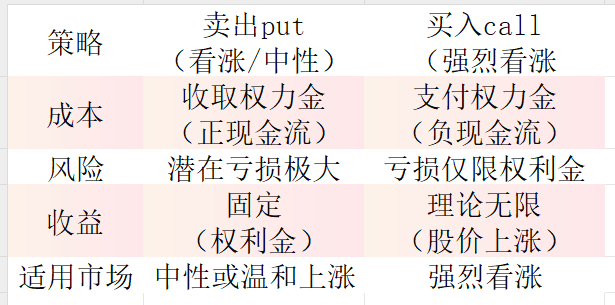

5. 賣出Put vs 買入Call(看漲策略對比)

6. 總結

賣出Put的本質:通過承擔“接盤義務”賺取權利金,適合對股價有明確支撐預期的投資者。

優勢:無需直接持有股票即可獲得收益,或在回調時低成本建倉。

風險警示:潛在虧損遠高於收益,需嚴格管理倉位(避免重倉單一標的)。

新手建議:先通過模擬交易熟悉操作,並學習如何用止損、對沖(如買入更低執行價的Put)控制風險。

再次聲明,本公衆號文中提到的所有公司,都只是企業經營思考,不涉及公司交易,更不構成任何投資建議和評價。

(轉自:投資人記事)

免責聲明:投資有風險,本文並非投資建議,以上內容不應被視為任何金融產品的購買或出售要約、建議或邀請,作者或其他用戶的任何相關討論、評論或帖子也不應被視為此類內容。本文僅供一般參考,不考慮您的個人投資目標、財務狀況或需求。TTM對信息的準確性和完整性不承擔任何責任或保證,投資者應自行研究並在投資前尋求專業建議。

熱議股票

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10