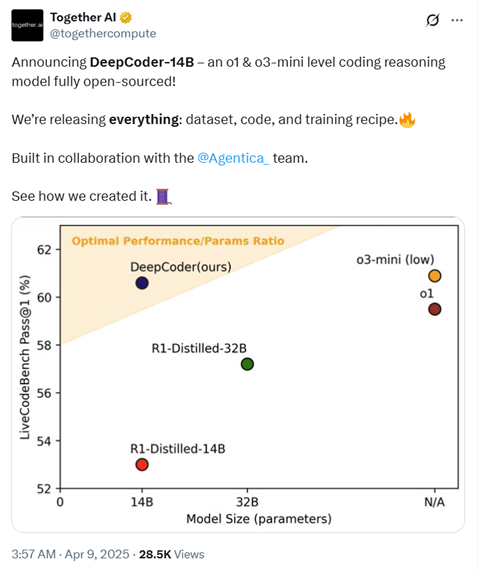

今天凌晨4點,著名大模型訓練平台Together AI和智能體平台Agentica,聯合開源了新模型DeepCoder-14B-Preview。

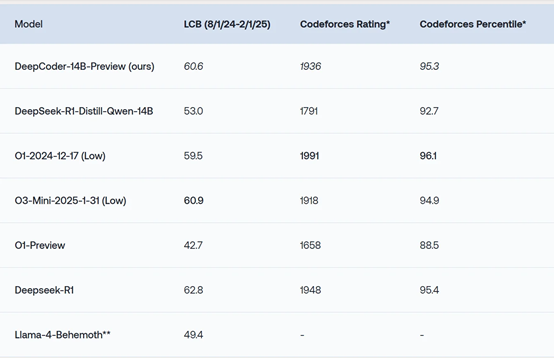

該模型只有140億參數,但在知名代碼測試平台LiveCodeBench的測試分為60.6%,高於OpenAI的o1模型(59.5%),略低於o3-mini(60.9%)。在Codeforces、AIME2024上的評測數據同樣非常出色,幾乎與o1、o3-mini差不多。

值得一提的是,Together AI不僅開源了DeepCoder-14B模型權重,還把訓練數據集、訓練方法、訓練日誌和優化方法全部公開,幫助開發者更深度的了解這個模型所有開發流程。

開源地址:https://huggingface.co/agentica-org/DeepCoder-14B-Preview

github:https://github.com/agentica-project/rllm

DeepCoder是在Deepseek-R1-Distilled-Qwen-14B基礎之上,通過分佈式強化學習(RL)進行了微調。

在開發過程中,研究人員首先構建了一個高質量訓練數據集,包含24K個可驗證的編程問題:涵蓋TACOVerified 問題、PrimeIntellect 的 SYNTHETIC-1 數據集中的驗證問題等。

為了確保數據質量,通過程序驗證、測試過濾和去重等步驟。程序化驗證,每個問題都會使用外部官方解決方案自動進行驗證。會過濾數據集,只包含官方解決方案通過所有單元測試的問題。

測試過濾,每個問題必須至少包含5個單元測試。重複數據刪除,刪除了數據集中的重複問題,以避免污染。

在代碼強化學習訓練中,DeepCoder 使用了兩種沙盒來運行單元測試並計算獎勵。Together Code Interpreter 是一個快速高效的環境,與RL訓練直接兼容,成本低且可擴展性強,能夠支持100多個併發沙盒和每分鐘1000多個沙盒執行。

本地代碼沙盒則是一個獨立的、受保護的 Python子進程,遵循官方 LiveCodeBench倉庫中的相同評估代碼,確保了結果與現有排行榜的一致性。

在獎勵函數設計方面,DeepCoder採用了稀疏結果獎勵模型(ORM),避免分配部分獎勵,從而防止模型通過獎勵黑客行為來獲取不準確的獎勵信號。

獎勵函數簡單而明確:如果生成的代碼通過所有采樣單元測試,則獎勵為 1;否則為 0。這種設計確保了模型能夠專注於生成高質量的代碼,而不是通過記憶測試用例來獲取獎勵。

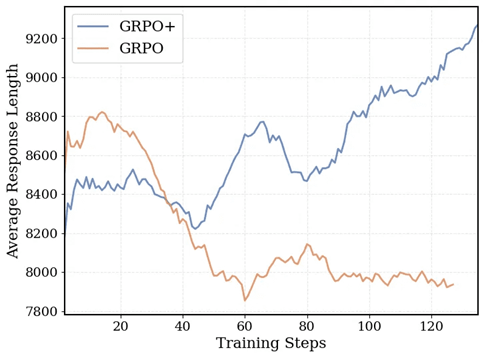

為了實現更穩定的訓練過程,DeepCoder的訓練採用了 GRPO+,這是對原始 GRPO 算法的改進版本。

通過消除熵損失和 KL 損失、引入過長過濾和上限裁剪等技術,GRPO+ 使得模型在訓練過程中能夠保持穩定的熵值,避免訓練崩潰,並且能夠更自然地生成較長的輸出,從而提高了模型的推理能力。

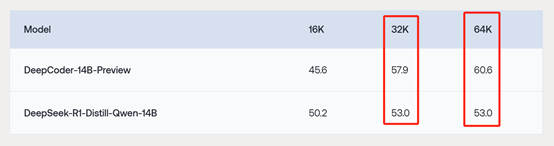

此外,DeepCoder-14B-Preview 採用了迭代上下文擴展技術,使模型能夠從較短的上下文長度開始學習,然後逐步泛化到更長的上下文。該模型的上下文窗口從 16K 擴展到 32K,最終在 64K上下文中評估時達到了60.6%的準確率。

為了加速端到端的RL訓練,DeepCoder 團隊引入並開源了 verl-pipeline,這是 verl 的一個優化擴展。通過一次性流水線技術,DeepCoder 實現了訓練、獎勵計算和採樣的完全流水線化。

同時,獎勵計算與採樣交錯進行,減少了獎勵評估的開銷。這些優化使得訓練時間減少了 2 倍,特別是在需要運行數千個測試用例的編碼任務中,顯著提高了訓練效率。

雖然DeepCoder剛開源但評價非常高,網友表示,這相當令人驚訝。它不僅是真正意義上的開源,而且他們還對廣義信賴域策略優化算法(GRPO)進行了多項改進,並且在訓練過程中為採樣流水線增添了額外的效率提升。

太厲害了!等不及這款模型在 Ollama 平台上體驗了。

聖誕節提前到來了。

傳奇!開源就應該這樣。

關於Together AI

Together AI成立於2022年,主打雲大模型平台支持超過200種開源AI模型,包括Llama系列、DeepSeek-R1等,並優化了高速推理和模型訓練的基礎設施。目前擁有超過3.6萬塊GB200 NVL72組成的超大GPU算力羣。

此外,Together AI還提供模型微調、Agent智能自動化工作流和合成數據生成等,為大企業提供底層服務。

前不久,Together AI剛獲得3.05億美元的B輪孖展,其估值也從去年的12.5億美元翻倍至33億美元。

本文素材來源Together AI,如有侵權請聯繫刪除