作者 | 徐豫

编辑 | 漠影

智东西1月29日报道,国产AI之光DeepSeek-R1正快速平替OpenAI、Meta、Google的模型,成为应用开发者的新选择。

该模型在知名AI开源社区Hugging Face上的下载量已超70万次,日增40%。

▲DeepSeek-R1跻身Hugging Face最受喜爱的模型前十名(图源:Clem Delangue X主页)

不过,DeepSeek强劲的增长势头,也引起了美方的高度关注。

今日凌晨CNBC报道称,美国海军基于“潜在安全和道德问题”,已要求内部人员禁止使用DeepSeek模型。

据玉渊谭天消息,昨天,美国多名官员回应DeepSeek对美国的影响,称其“蒸馏”技术是“偷窃”,正对其影响开展国家安全调查。

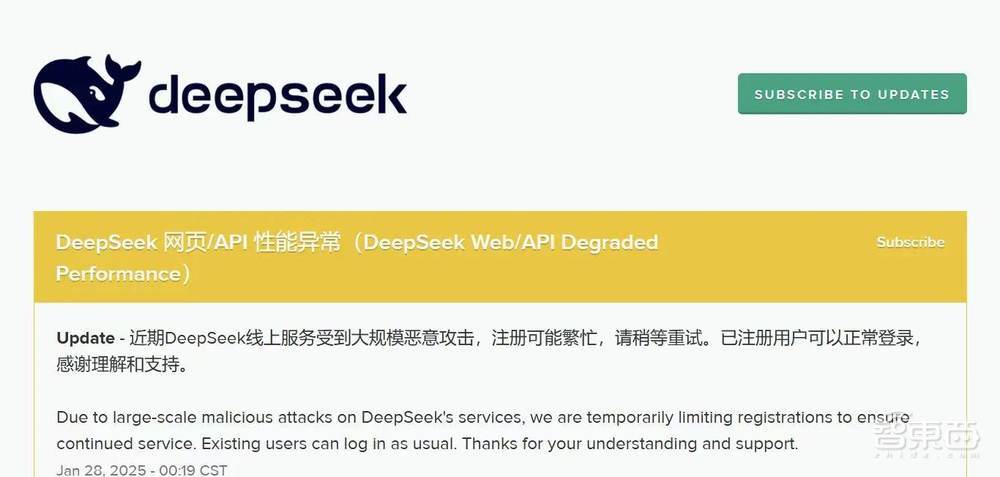

同日,DeepSeek官网的服务状态页面显示:“近期DeepSeek线上服务受到大规模恶意攻击,注册可能繁忙,请稍等重试。已注册用户可以正常登录,感谢理解和支持。”玉渊谭天向奇安信安全专家咨询并独家了解道,DeepSeek这次受到的网络攻击,IP地址都在美国。

截至发稿,在Chatbot Arena大模型榜单中,DeepSeek-R1基准测试排名已升至全类别大模型第二,超过OpenAI的o1和o1-mini模型,仅次于Anthropic的Claude3.5 Sonnet,热度持续攀升。

一、DeepSeek衍生模型数量日增30%,下载量超320万

Hugging Face首席科学官Thomas Wolf今天接受彭博社采访时,透露了DeepSeek-R1开源模型上线一周后增势强劲,并且该公司有计划在DeepSeek-R1的基础上,自研开源项目Open-R1。

Hugging Face社区内的开发者们正在公开复现DeepSeek-R1。主页的135万个模型中,检索“DeepSeek”相关的模型有将近2700个。

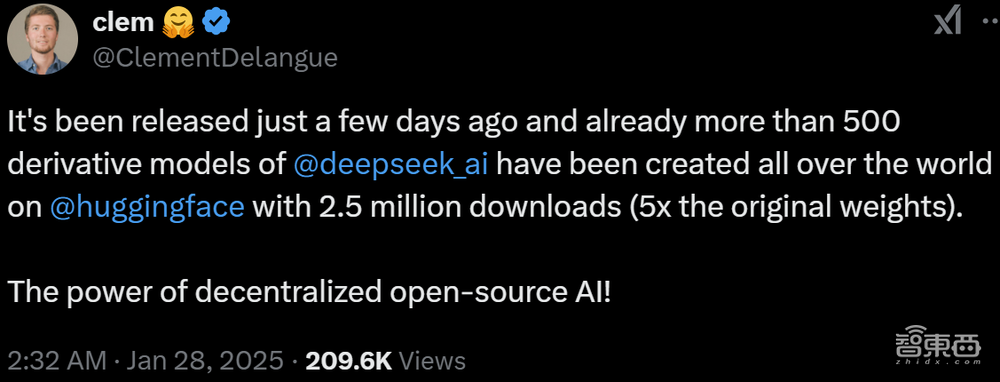

Hugging Face联合创始人兼CEO Clem Delangue 1月28日发帖称,DeepSeek-R1的衍生模型至少有500种。

Thomas Wolf今天给出了最新数据,用DeepSeek-R1搭建的模型至少有670个,累计下载量超320万次,日增约30%;而DeepSeek-R1的下载量超过70万次,日增40%。

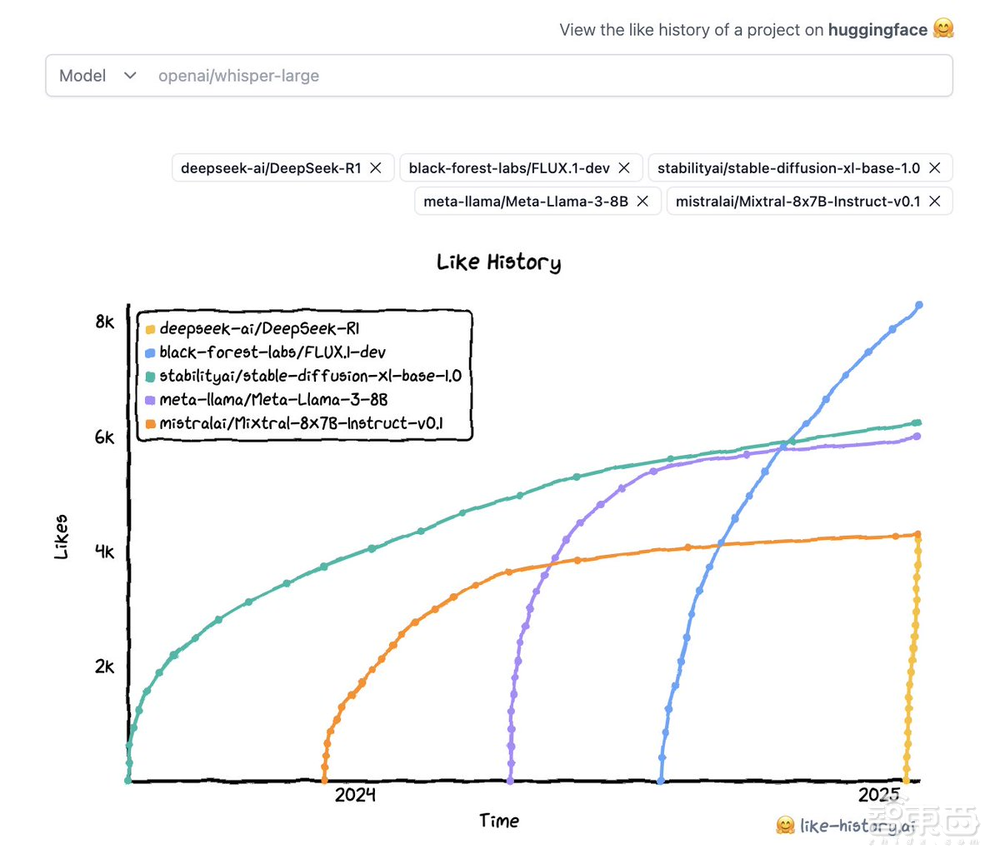

据Clem Delangue透露,DeepSeek-R1已进入该社区史上最受喜爱的模型前十名之列。

截至1月29日,Hugging Face社区点赞数排行前十的AI模型依次是:

1、黑森林实验室的FLUX.1-dev

2、CompVis的stable-diffusion-v1-4

3、Stability AI的stable-diffusion-x1-base-1.0

4、Meta的Llama-3-8B

5、BigScience的bloom

6、Stability AI的stable-diffusion-3-medium

7、DeepSeek的DeepSeek-R1

8、Mistral AI的Mixtral-8x7B-Instruct-v0.1

9、Meta的Llama-2-7B

10、Meta的Llama-2-7B-chat-hf

二、Hugging Face开搞Open R1,要研究透DeepSeek

跟上众多开发者的潮流,Hugging Face也打算基于DeepSeek-R1复刻一套自己的新模型,即Open-R1项目。

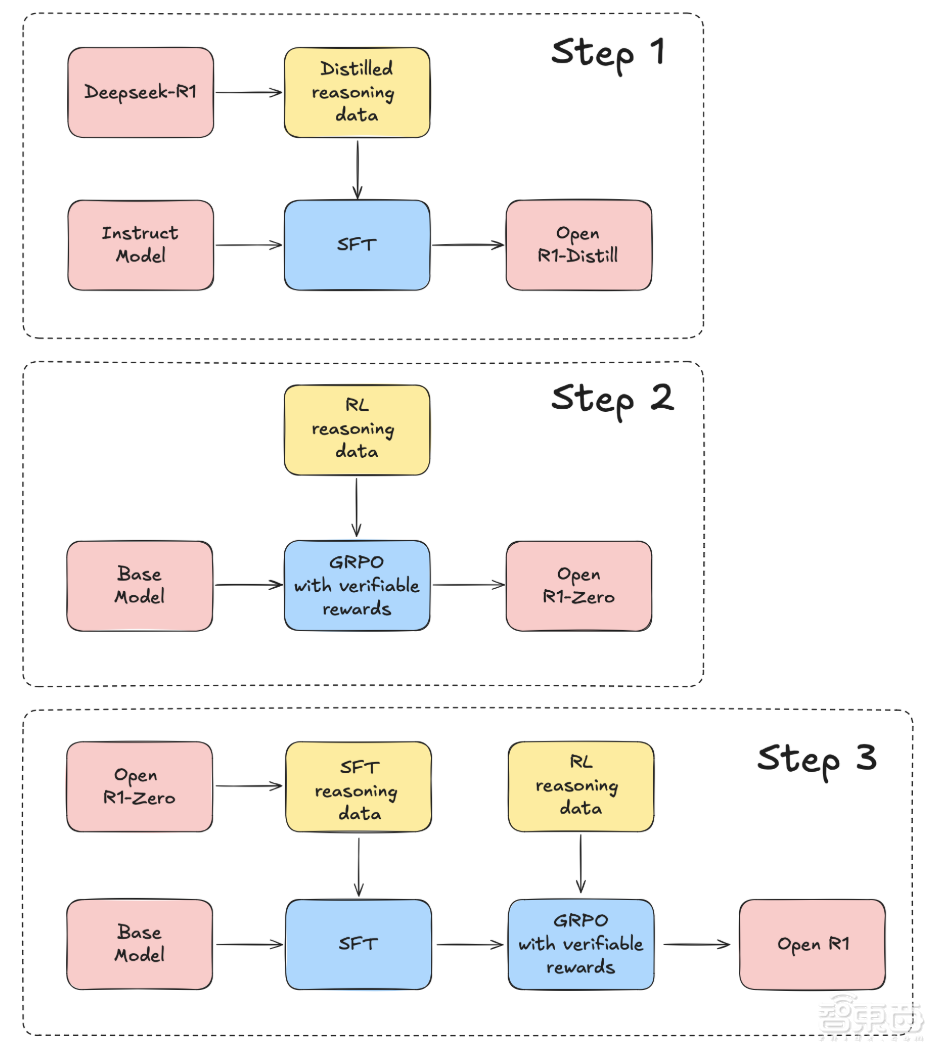

据Hugging Face官网1月28日介绍,Open-R1项目将重建DeepSeek-R1的数据和训练管道,并在这个过程中验证其效果、突破其上限,从而增强推理的透明度,以及积累可复制的经验。

不同开发商的复刻方法不尽相同。针对DeepSeek-R1遗留的特定推理数据收集方法、未公开模型训练代码、训练时的计算和数据缩放定律等问题,Open-R1计划通过以下步骤补齐这些空白板块:

首先,从DeepSeek-R1中提取高质量推理数据集,来复制R1-Distill模型。

然后,复制DeepSeek用于创建R1-Zero的纯RL管道,这个过程将涉及为数学、推理和代码任务,整理新的大规模数据集。

最后,可以通过多阶段训练,实现从基础模型到SFT(监督微调),再到RL(强化学习)的模型进阶。

▲Open-R1复刻DeepSeek-R1的计划示意图(图源:Hugging Face官网)

按照Thomas Wolf的预期,其团队将在接下来的几个月内弄清楚这些细节问题,并应用于Open-R1项目。

三、谷歌前CEO:全球AI的转折点已经到来

这场有关DeepSeek的硝烟,不仅仅笼罩了OpenAI、Meta、Google等一众主流模型开发商,使其着手研究如何降低模型的开发成本;也进一步蔓延至中美两国的AI博弈大局。

不到两周前,美国商务部工业和安全局(BIS)才颁布了芯片出口限制最新规定。其中,BIS共拉黑了11家与先进AI技术有关的中国实体。

在The Verge昨晚的报道中,OpenAI前政策研究员Miles Brundage称,像DeepSeek-R1这种推理模型通常需要使用大量GPU,会受到美国芯片出口管制的干扰。

在Miles Brundage看来,DeepSeek-R1使用了两个关键的优化技巧,一是更高效的预训练,二是思维链推理强化学习,这在一定程度上使其能以更少的GPU数量、更便宜的GPU,推动DeepSeek-R1实现了更强大的性能。因此,Miles Brundage称,美国对GPU实施有效的出口管制,比以往任何时候都更为重要。

不过,OpenAI首席研究官Mark Chen则倾向于外界夸大了DeepSeek-R1的成本优势。他一方面认可了DeepSeek独立开发出了OpenAI o1级别的推理模型,但另一方面认为两者在开发成本上的差距并没有那么大,仍然对OpenAI的技术路线持乐观态度。因此,从某种意义上说,DeepSeek还是有被先进GPU卡脖子的风险。

另外,有不少观点认为DeepSeek-R1的出现将惠及部分美国科技巨头。

《华尔街日报》1月27日报道称,DeepSeek-R1的技术突破意味着,不少美国科技巨头可能不必花费太多时间、精力和算力,来训练他们的AI模型。

而且这些模型都是开源的,开发人员可以检查和修改其代码,并用它来构建自己的应用程序。这可以帮助更多小企业花费比闭源模式低得多的成本,用上AI,并且开源可以促进更多合作和实验。

摩根士丹利分析师Brian Nowak称,苹果也将因DeepSeek等大模型的任何进展中受益匪浅,原因是苹果“拥有现存最有价值的消费技术分发平台”。

谷歌前CEO Eric Schmidt昨天告诉《华盛顿邮报》,他认为美国需要加大开源AI研发力度,开发出更多开源模型,鼓励先进AI实验室共享训练方法,以及投资星际之门等AI基础设施,以应对DeepSeek的迅速发展。

Eric Schmidt还一改去年“美国领先”的说辞,在《华盛顿邮报》专栏文章中称,DeepSeek的崛起标志着全球AI“转折点”的到来,证明了中国可以用更少的资源与大型科技公司竞争。

结语:国产模型出圈新路线,Meta、Hugging Face等争相模仿

目前,有的团队和机构正在研究、复刻DeepSeek-R1,有的尝试用该模型重塑自家模型,例如Meta、Hugging Face、UC伯克利、港科大等。

同时,2025年开年,DeepSeek-R1将推理模型竞赛推向新拐点,有望凭借低算力、高性价比的技术路线,开拓国产模型的全球市场。

春节期间DeepSeek掀起的这场AI风暴,仍在中美乃至全球科技、政金界产生持续影响,并不断发酵。这已经成为改变AI科技产业趋势的风向标事件,智东西将持续跟进相关进展和报道,敬请关注。