文|数据猿

公有云巨头的收入增长放缓了!并且有持续延续下去的可能!

云市场规模最大的亚马逊云科技(AWS)2024年最后一个季度的收入仅增长了13%,第三季度增长了19%。而2023年AWS总营收907.5亿美元,相比2022年同比增长13.4%。2022年全年AWS实现销售收入801亿美元,与2021年增长率为29%。

微软Azure 2024年最后一个季度的收入增长了19%,谷歌云实现了30%的增长,均低于市场预期。而2024年第三季度,微软Azure增长了20%,谷歌云增长了35%。

三大云巨头虽然收入增长放缓,但却占据全球云市场的67%。而IDC的数据显示,阿里云、腾讯云、华为云2024年上半年云计算收入增长也没有超过15%。

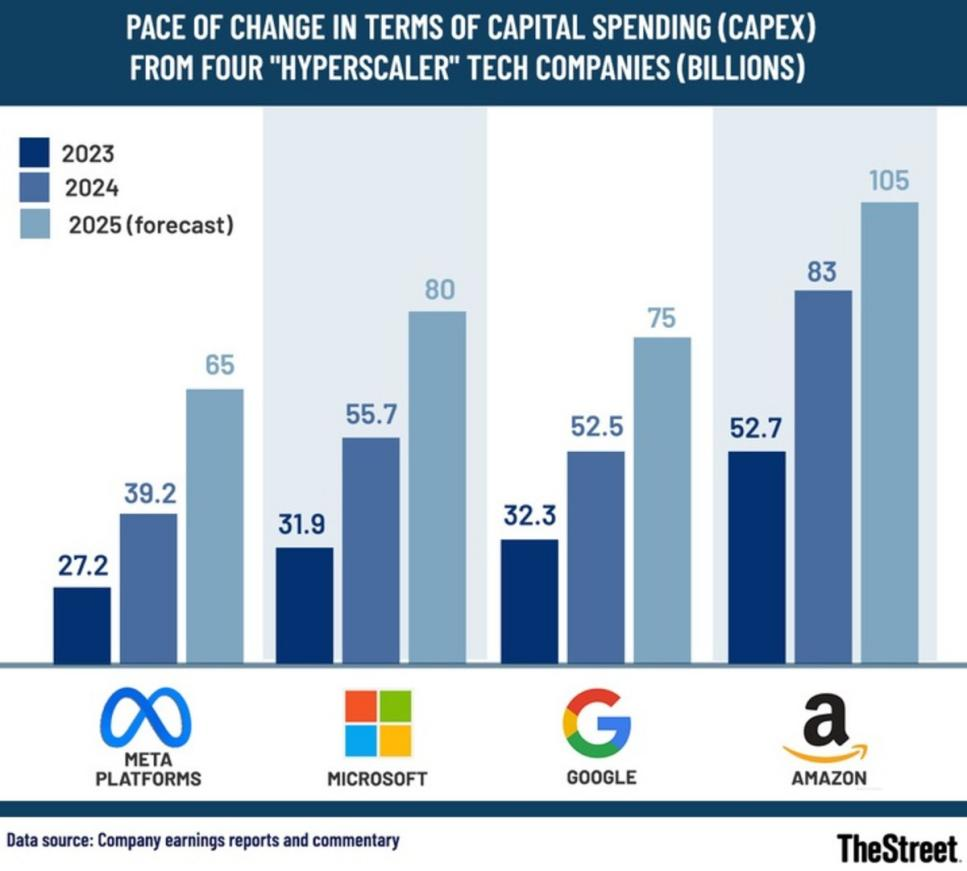

与收入增长放缓相比,云巨头对AI基础设施的投资却不断增大。相关数据显示,2024年,AWS投资780亿美元,微软投资760亿美元,谷歌云投资530亿美元,同比增加了38%。

2025年,微软承诺在AI基础设施投资增加800亿美元,亚马逊计划花费1000亿美元来抓住AI领域这“千载难逢的机会”,谷歌云的母公司Alphabet预计2025年将投资约750 亿美元,构建其人工智能产品。

AI基础设施瓶颈迫使云巨头加大在数据中心AI基础设施上的投资,然而短期回报却甚微。两相对比,投资者开始质疑云服务商大规模AI投资的合理性。

AI大模型带动云计算市场增长,而云巨头收入增长却放缓了

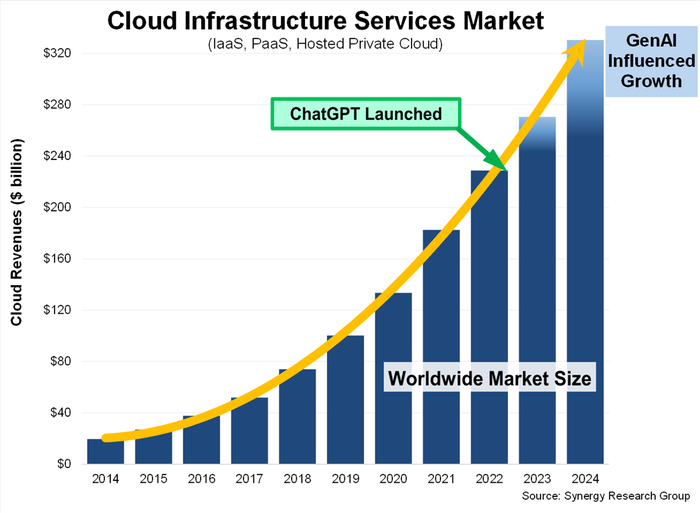

据2024年云计算市场达到3300亿美元。Synergy Research Group的数据显示,2024年云市场达到创纪录的3300亿美元,与2023年相比增加了约600 亿美元,比2022年增加了1020亿美元。

亚马逊云科技、微软Azure、谷歌云、阿里云、Oracle OCI在全球云市场规模排名中位于前五。

AWS仍然是全球市场份额的领导者。AWS在第四季度赢得了30%的份额,在全球市场份额中排名第一。Azure以21%的份额排名第二,谷歌云以12%排名第三。

作为对比,2023年第四季度,AWS赢得了31%的市场份额。Azure赢得了24%的份额,谷歌云份额11%。

AWS在2024 年第四季度创造了288亿美元的收入,年收入超过1150亿美元。微软的智能云业务在第四季度的总销售额为255亿美元,该云集团(包括Azure、服务器产品和其他云服务收入)现在每年产生1020亿美元的收入。谷歌云第四季度的总收入为120亿美元,2024年收入为480亿美元。

谷歌云仍然是全球增长最快的云公司,在2024年第四季度的销售额同比增长30%,比竞争对手AWS和微软增长更快。

微软的云业务在三者中拥有最高的营业利润。微软云智能集团在2024年第四季度创造了108.5亿美元的营业利润。与2023年第四季度的95.5亿美元相比增长了14%。2024年第四季度AWS利润为106亿美元,谷歌云为21亿美元。

云收入的增长主要归功于AI大模型和AI创新。Synergy Research Group报告认为,GenAI至少贡献了云服务收入增长的一半,主要有两个动力,一是来自新推出的GenAI/GPU服务,二是来自对现有云服务的AI驱动改进。

Gartner预计公有云支出将在2030年超过万亿美元大关,并认为生成式AI和应用现代化的兴起推动了市场增长。

为此,微软 CEO Satya Nadella表示,公司云基础设施战略侧重于构建“可替代舰队”,确保在训练和推理能力之间取得适当平衡,同时保持数据中心地理分布的合理。

Alphabet CEO Sundar Pichai指出,仅仅建立新的数据中心是不够的,“与五年前相比,Google 数据中心每单位电力提供的计算能力几乎高出四倍。”这种效率与可扩展性和性能相结合,推动了客户云和AI的采用。与18个月前相比,谷歌云客户现在用于训练和推理的计算容量增加了8倍以上。

AWS一直在急于投资数据中心、网络设备和硬件,以满足对生成式AI的巨大需求。亚马逊也推出了一系列人工智能产品,包括自己的Nova模型、Trainium芯片、购物聊天机器人和名为Bedrock 的第三方模型市场。在亚马逊CEO Andy Jassy 强调,今天所知道的几乎所有应用都将使用AI进行重塑,推理将成为核心构建块,就像计算、存储和数据库一样。

云计算市场的几大巨头在发展中,一方面加大对AI基础设施的投资,以满足不断增大的需求;另一方面优化成本,包括裁员、推出免费方案、优惠套餐等,旨在帮助企业优化云计算成本并推动可持续发展。

AI投资持续增长,供需矛盾难以化解。云计算企业加大了在AI基础设施方面的投资,以持续云计算市场的高增长。

对于三大超大规模云服务商来说,人工智能既是增长的主因,也是对未来的隐忧。AWS、微软和Google都报告了强劲的云收入增长,主要是由AI需求推动的,但持续的AI算力包括高端AI加速器如GPU供应受限,以及电力供应限制(增加核电设施)对其扩展数据中心容量构成了挑战。

在需求激增的情况下,三大云巨头都面临产能限制,尤其是“对AI产品的需求超过了可用的产能。”

毫无疑问,AI大模型对云计算市场的影响巨大而深远的。云计算成为AI大模型发展与应用的战略选择,带动了云计算市场规模的增加。据有关数据预测,2024-2030年全球整体云计算市场规模年复合增长率为16.8%,AI云的占比为34%。信通院报告显示,大模型推动云计算产业开启新一轮增长,2023年中国云计算市场规模达6165亿元,同比增长35.5%。

AI大模型对算力需求激增。IDC与浪潮信息联合的发布报告指出,大模型和生成式人工智能推高算力需求,中国智能算力增速高于预期。2024年,中国智能算力规模达725.3EFLOPS,同比增长74.1%,增幅是同期通用算力增幅(20.6%)的3倍以上;市场规模为190亿美元,同比增长86.9%。

未来两年,中国智能算力仍将保持高速增长。2025年中国人工智能算力市场规模将达到259亿美元,较2024年增长36.2%;2026年市场规模将达到 337亿美元,为2024年的1.77倍。

报告认为在人工智能算力发展过程中应采取“扩容”和“提效”并行的策略。“扩容”是指增强算力资源的可获得性,通过增加智算中心的数量,实现充足的多元算力供给;“提效”则需要从算力基础设施建设和优化、算法创新、提高数据质量、降低能耗等方面系统性实现。

而DeepSeek基于算法层面的极大创新,对中国乃至全球的人工智能产业带来深刻变革,算法成为驱动人工智能发展的核心引擎,正牵引着算力的发展,也驱动了计算架构和数据中心变革。

生成式人工智能已成为企业重要的新型工作负载,大模型的开源趋势正在显著增强,成为加速AI普惠、降本增效的重要力量。另外,AI大模型促使云计算与人工智能、大数据等技术深度融合,提供更智能、更高效的云服务。

如SAP一方面与谷歌云合作,将生成式AI引入数据云平台;同时SAP采用 Databricks湖仓一体架构,推出了Business Data Cloud(BDC),帮助团队使用来自不同源系统的外部数据资产丰富其 SAP 生态系统数据,并推动长期价值。

AI大模型推动云计算从传统的IaaS、PaaS、SaaS模式向MaaS(模型即服务)模式拓展。MaaS将人工智能(AI)算法模型以及相关能力进行封装,以服务的形式对用户提供,其核心目标是降低人工智能技术使用门槛,控制应用建设成本,简化系统运维管理复杂度。

另外,开源大模型的出现,使云厂商的收费逻辑发生变化,如适配模型客户调用API按照每千tokens收钱,客户应用部署租赁云厂算力按实际算力算费用等。

AI工作负载成本居高不下,构建和维护AI模型成本难以预测和控制

目前,大型语言模型和其他计算密集型系统的工作负载的成本居高不下。虽然DeepSeek打破了AI大模型发展的传统范式——使用昂贵的GPU,消耗大量电力和资源,通过训练更大的模型,换取AI性能的线性增长,但是虽然对于涉及尤其如此。训练单个高级AI模型花费依然很高,此外还有微调、重新训练和推理等成本。

公有云服务商拥有庞大的基础设施来处理这些任务,但对许多企业来说,成本越来越不可持续。随着企业从采用AI的实验和训练阶段进入生产规模推理,财务成本开始超过收益。

云计算拥有可预测的经济优势,包括即用即付定价和按需弹性。随着AI用例在整个企业中的增长和扩展,当企业面临全天候使用成百上千个GPU或AI所需的其他资源时,这些可预测的经济优势很快就会失去光环,成本和收益之间的差距不断扩大。

同时全球能源成本不断上升,AI系统需要不断增加的电力来进行训练、冷却和部署。IDC的报告表明,2024年上半年,企业用于AI部署的计算和存储硬件上的支出增长了37%。公有云仍在早期AI投资中占据大部分份额。但有趣的是,越来越多的支出被重定向到公共云服务商之外。

因此,云巨头收入增长减缓的一个重要原因是云服务商的AI生态系统开发没有达到预期。云服务商在AI基础设施和服务方面进行了大量投资,但在这些平台上构建和维护AI模型的成本难以预测和控制。

挑战不仅在于拥有足够的GPU或数据中心容量,还在于公有云的构建方式与AI工作负载的需求之间的根本不一致。当企业尝试在传统云基础设施上扩展其AI计划时,通常会遇到不可预测的成本、性能瓶颈和基础设施限制,使得持续增长变得困难。

一是基本的架构不匹配,通用计算需求构建的基础设施难以满足AI工作负载的特殊需求。公有云服务商构建了通用基础设施来适应通用计算工作负载,并在过去十多年中占据主导地位,满足企业通用和标准应用的计算需求。但是AI工作负载有所不同,需要专门的硬件配置、海量数据吞吐量和复杂的编排功能,并不是原始公有云设计理念的一部分。

另外,基础设施本身并未针对AI应用的密集、持续的计算需求进行优化,适用于运行Web应用或数据库的方法并不适用于现代AI工作负载。

二是适用于传统应用的定价模型在应用于AI工作负载时变得异常昂贵。运行AI大语言模型或训练复杂AI系统的企业会发现,云费用飞涨,而且通常没有取得成比例的商业价值。因为担心云账单大大高出预期,企业不得不部署一个可能会耗尽IT预算的AI系统。

在公有云中部署简单、可扩展的 AI 的承诺往往伴随着隐藏的复杂性和成本,难以实现增长。因此越来越多的企业正在探索替代方法,包括私有AI基础设施和混合解决方案,在成本和性能之间找到了适当的平衡。

除了技术限制的问题外,公有云的商业模式也难以适应。公有云服务商需要认识到,AI需要采用不同的方法来处理基础设施、定价和服务交付。对于大多数企业来说,当前对通用计算资源收费和为AI特定服务增加额外费用的模式是不可持续的。

成本管理是另一个重要的考虑因素。财务团队应认真监控云费用,配备可实时跟踪使用情况的工具,分析总拥有成本,发现有关预留实例和承诺使用折扣的方案,为其AI工作负载选择可预测的最经济的选项。

云服务成本上升趋势没有得到遏制,出口费用和其他隐藏成本不可忽视

在公有云服务成本不断上升的推动下,将应用和数据迁回到本地环境的企业客户不断增加。根据费用和资产管理解决方案提供商Tangoe的报告,与2023年相比,2024年用户在云上的支出平均增加了30%,而AI和GenAI是罪魁祸首。

报告显示,AI和GenAI导致的成本上升开始引起关注。在接受调查的500名美国FinOps从业者中,有72%的人表示GenAI在云中的支出“变得难以管理”。

虽然云服务总体支出的增加并不一定意味着单个组织的云成本增加,但可以肯定地说,许多企业的成本都在增加。在某些情况下,甚至可能存在失控的支出,从而削减云的财务优势。

众所周知,随着数字化和智能化的推进,企业与组织正在部署越来越多的云服务,以实现在降低成本的同时提高业务敏捷性和可扩展性的目标。但遗憾的是,企业云采用率的增加可能会导致支出成本失控,企业迫切需要寻找控制其云成本的方法。

另外,出口费用和其他隐藏成本也没有完全消除,导致企业重新评估其云战略。从特定云服务商处删除数据或者将数据从公有云服务商迁移到本地甚至其他公有云服务商,云服务商往往收取数据传输费用或“出口费用”。

近几年来,云服务商正在通过降低出口费用以启动其定价策略的重大转变。2024年1月12日,谷歌云取消客户“出口费用”,适用于全球并立即生效且。这一豁免涵盖BigQuery、Cloud Storage等一系列谷歌云服务。此举旨在增强云服务互操作性,给予客户更大数据管理自由度。

2024年3月,AWS为将数据迁移到AWS之外的客户免除数据传输费用,旨在提升客户数据迁移的灵活性,减少数据迁移成本壁垒。此前,AWS提供限量的免费政策,已使超90%客户无需承担迁出数据的传输费。

这些变化标志着公有云计算行业正在向更灵活和更具竞争力的定价结构发展,减少了更换服务商或更常见的采用多云和混合云架构的经济障碍。

为优化云计算成本,云巨头频出新招。AWS为优化云计算成本,推出一系列举措。AWS于 2024年重新启动 “节俭架构”(the frugal architect)计划,旨在帮助企业优化云计算成本并推动可持续发展。该计划最初于2023年在re:invent大会上推出,提出了七条简单法则,用于构建具有成本意识、可持续性和现代化的架构。

AWS还提供多种灵活购买选项,比如免费套餐、储蓄计划、预留实例等,最高可享72%折扣,使用竞价型实例运行容错工作负载能省90%。还能提高资源利用效率,通过调整资源大小、删除未使用资源、合理选择存储和传输选项来降低成本。

此外,自动伸缩功能可根据需求动态调整实例数量和大小,结合负载均衡,实现灵活资源管理。同时,借助AWS Cost Explorer等工具持续监控和优化成本,设置费用阈值报警,防止超支。

阿里云在2024年进行了三次大模型降价,5月21日,通义千问GPT-4级主力模型Qwen-Long 的API输入价格直降97% ;9 月19日,三款通义千问主力模型再次降价,最高降幅85%;12月31日,第三轮降价来袭,Qwen-VL-Plus输入价格降幅达81.3%。

腾讯云则借各类促销节点推出优惠活动,如双十二期间,新用户首单直降,服务器限时秒杀,还有买赠专区等,以此降低用户使用云服务成本,增强市场竞争力。

那么企业用户如何控制云成本增加?为此,专家们为控制云成本提供了很多建议。

确保云服务一直符合要求。当公司采购云服务时,通常是为了满足特定需求或利用市场机会。有时这会是一个短期要求。例如,企业可能需要在向市场推出新产品或服务之前启动大数据分析项目。基于云的服务提供了收集和分析客户和市场数据的方法,提供了必要的计算资源。

但是,项目完成后,就不再需要这些云服务。一个关键做法是“合理调整规模”,随着使用量的变化定期重新评估云支出,确保云服务与组织需求相匹配的一个重要部分是持续审查云服务的使用情况。

另外,利用预留实例,如AWS提供 Amazon EC2 预留实例(RI),与按需定价相比,它可以提供高达72%的服务折扣。在特定可用区中使用时,它还可以提供容量预留。

部署存储自动缩放、利用分析工具监控使用情况等也是化解成本上升的重要措施。

专业AI提供商和微云正进一步分散市场,为用户提供信的选择

专业AI提供商和微云的出现,正在进一步分散云市场。与通用云平台相比,专注、专业的基础设施,可以为AI工作负载提供更好的性能和价值。

正如大多数IT人员所知,市场对GPU的需求量增加,对于运行和训练生成式AI模型至关重要。而一些企业没有选择使用AWS、谷歌云和微软Azure等“传统”云服务锁提供的一系列 GPU资源,而是选择微云等专业AI服务,满足自己的需求。

对于需要GPU的AI项目,微云通常是更具成本效益的解决方案。与Azure或谷歌云相比,在CoreWeave或其他微云平台上租用流行的GPU(如 Nvidia A100 40GB)的成本可以显著降低。

如今,云计算的热门新趋势是微云Microclouds,将云计算与边缘基础设施融合在一起的。微云是一种云计算策略,在传统数据中心外部署即用型服务器集群,含硬件与预配置软件环境,使工作负载按云模型使用硬件,如构建私有云或举办活动用临时集群。

Canonical普及该概念并推出产品,在其之前已存在约五年。现在CoreWeave、Lambda Labs、Voltage Park和Together AI等企业处于这一领域的最前沿。微云概念背后的主要价值主张很简单:通过提供一种将服务器部署到任何位置的简单方法,使计算资源更靠近最终用户。通过扩展,它们可以提供本地基础设施的许多优势,如减少延迟。由于微云由预配置的服务器组成,客户可以在几分钟内完成部署,因此它们比传统的本地硬件更容易设置和管理。

换句话说,微云提供了传统云计算平台的便利性,但不限制客户在云数据中心内托管工作负载。借助微云,您可以将工作负载放置在任何所需的位置。

像微云这样的AI 工作负载的专用基础设施具有多项优势。因为可以更有效地支持资源密集型工作负载,所以可以为AI计划提供更好的价值。这种基础设施使公司能够通过投资专门的AI加速器来有效地平衡成本和性能,提供了对AI工作负载的更多控制,并带来了更好的经济效益。

未来微云将引入更多智能化功能,如人工智能和机器学习,以优化数据管理和用户服务体验。通过智能分析用户行为,微云可以提供个性化的存储和管理方案。同时微云将进一步加强数据加密和访问控制机制,确保用户数据的安全性和隐私性。

鱼与熊掌不可兼得!AI大模型算力需求与可用产能之间,云巨头们正面临着当下投入与未来收益难以平衡的严峻挑战。