专题:DeepSeek为何能震动全球AI圈

来源:玩亦可及

2025年1月20日,杭州深度求索人工智能基础技术研究有限公司正式发布了其最新研发的高性能AI推理模型——DeepSeek R1。该模型在数学、代码和自然语言推理等任务上表现卓越,性能直接对标OpenAI的o1正式版,同时以开源形式向全球开发者开放,并使用MIT协议开源,支持免费商用,无需申请授权,为LLM大模型开源世界又补给了满满一仓库弹药。

好巧不巧,以文本处理和输出见长的另一家国内大模型公司——月之暗面,也发布了Kimi k1.5推理模型,同样号称比肩OpenAI o1。一个开源,一个闭源,国产大模型技术,似乎和世界顶级水平正在拉近。

扩展阅读:

- 《思源笔记同时调用文心Ernie、Moonshot、DeepSeek、豆包大模型》

- 《AI自动撰写WordPress文章的脚本,DeepSeek V3 10秒搞定》

DeepSeek R1的核心优势

DeepSeek R1的最大亮点在于其通过强化学习(RL)技术显著提升了模型的推理能力,且仅需极少量标注数据即可实现高效训练。与OpenAI的o1相比,R1在多个基准测试中表现优异,同时价格仅为o1的几十分之一,具有极高的性价比。

-

强化学习驱动的推理能力

R1在后训练阶段大规模应用了强化学习技术,无需依赖大量监督微调(SFT)数据,即可显著提升模型的推理能力。这一创新方法不仅降低了训练成本,还使模型在复杂任务中表现出色。

-

长链推理与模型蒸馏

R1采用了长链推理(Chain-of-Thought, CoT)技术,能够逐步分解复杂问题,并通过多步骤逻辑推理解决问题。此外,R1支持模型蒸馏,开发者可以将其推理能力迁移到更小型的模型中,满足特定场景需求。

-

开源与灵活的许可证

R1遵循MIT License开源协议,允许用户自由使用、修改和商用。同时,DeepSeek还开源了R1-Zero和多个蒸馏后的小模型,进一步推动了AI技术的普及与创新。

性能评测对比

以下是DeepSeek R1与其他主流模型在多个基准测试中的表现对比:

| 模型 | AIME 2024 (%) | MATH-500 (%) | Codeforces Elo | MMLU (%) | GPQA Diamond (%) |

|---|---|---|---|---|---|

| DeepSeek R1 | 79.8 | 97.3 | 2029 | 90.8 | 71.5 |

| OpenAI o1-1217 | 78.5 | 96.8 | 2015 | 91.2 | 70.8 |

| DeepSeek-V3 | 68.7 | 89.4 | 1950 | 85.6 | 65.3 |

| Qwen2.5-32B | 55.5 | 72.6 | 1800 | 78.4 | 60.2 |

| Llama3-70B | 58.3 | 75.1 | 1825 | 79.8 | 61.5 |

数据来源:

R1系列模型及其蒸馏版本的性能表现

DeepSeek此次发布了R1-Zero、R1以及多个蒸馏后的小模型,以下是它们的性能对比:

|

模型 |

AIME 2024 (%) | MATH-500 (%) | LiveCodeBench (%) |

|---|---|---|---|

| DeepSeek R1-Zero | 71.0 | 89.7 | 55.2 |

| DeepSeek R1 | 79.8 | 97.3 | 57.2 |

| R1-Distill-Qwen-1.5B | 65.4 | 85.2 | 52.8 |

| R1-Distill-Qwen-7B | 68.9 | 88.6 | 54.3 |

| R1-Distill-Qwen-8B | 70.2 | 89.1 | 55.0 |

| R1-Distill-Qwen-14B | 72.6 | 90.5 | 56.1 |

| R1-Distill-Qwen-32B | 72.6 | 94.3 | 57.2 |

| R1-Distill-Llama-70B | 70.8 | 93.5 | 56.8 |

| Qwen2.5-32B (原始) | 55.5 | 72.6 | 45.0 |

| Llama3-70B (原始) | 58.3 | 75.1 | 47.5 |

数据来源:

从表中可以看出,R1蒸馏后的小模型在推理能力上显著超越了原始的Qwen2.5和Llama模型,展现了R1推理模式的高效迁移性。

应用开发者的视角:DeepSeek R1与V3的本地部署与使用

1. DeepSeek R1蒸馏模型的本地部署

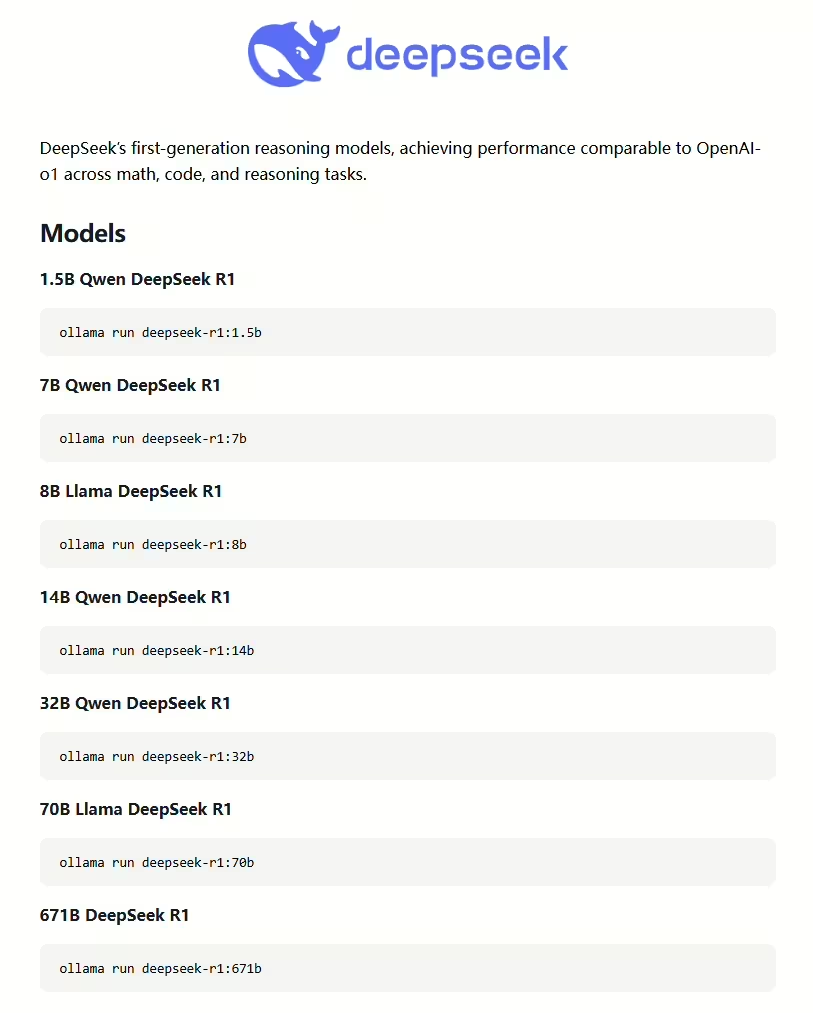

DeepSeek R1蒸馏出的1.5B、7B、8B、14B等小模型非常适合在本地部署,尤其适合资源有限的中小企业和开发者。以下是常用的部署工具和方法:

- 工具推荐:

- Ollama:一个开源的大型语言模型服务工具,支持多GPU配置、热加载模型和与OpenAI兼容的API接口,适合快速部署和运行大规模预训练语言模型。

- vLLM:支持FP8和BF16推理模式,适合高吞吐量的推理任务。

- LMDeploy:支持本地和云部署,提供高效的FP8和BF16推理支持。

- TensorRT-LLM:支持INT4/8量化,适合需要极致性能的场景。

- SGLang:完全支持BF16和FP8推理模式,适合多令牌预测任务。

- 部署步骤:

- 从Hugging Face下载模型权重。

- 使用DeepSeek-Infer Demo进行权重转换(如将FP8权重转换为BF16)。

- 配置推理框架(如vLLM或LMDeploy),加载模型并启动服务。

目前DeepSeek R1蒸馏出来的这6个小体积模型,已经上线到Ollama官网。已经在本机安装Ollama的朋友,可以直接通过命令行工具,用ollama pull或ollama run命令下载和运行这些模型。我个人刚把原始版的Qwen2.5 7B删除,安装经过DeepSeek R1蒸馏过的Qwen 7B模型。我的7800XT显卡有16GB显存,FP8或INT8量化后,跑14B参数的模型应该也不是问题。

2. FP8与INT8量化方式

量化是降低模型显存占用和计算开销的有效方法,以下是FP8和INT8量化的实现方式:

- FP8量化:

- E4M3与E5M2格式:FP8支持两种格式,E4M3提供更精确的数值,E5M2提供更大的动态范围。DeepSeek V3在训练中采用了E4M3格式,以保持较高的数值精度。

- 量化流程:在输入采用BF16,主权重采用FP32,量化到FP8。前向传播时,累加后输出为FP32,再转换为BF16;反向传播时,权重梯度以FP32更新,激活梯度转换为BF16继续传播。

- INT8量化:

- 逐张量量化:对整个张量进行量化,使用一个scale表示。

- 逐行量化:对每一行或列进行量化,每行使用一个scale。

- 分组量化:将特定数量的元素分为一组,每组使用一个scale。

- 分块量化:对特定区域进行量化,每块使用一个scale。

3. DeepSeek R1与V3的应用场景对比

- DeepSeek R1:

- 适用场景:数学建模、代码生成、复杂逻辑推理。

- 开发者使用:集成到智能客服、自动化决策系统中,提升复杂任务的解决效率。

- 内容创作者使用:用于生成逻辑严谨的技术文档或学术论文。

- DeepSeek V3:

- 适用场景:自然语言处理、知识问答、内容创作。

- 开发者使用:用于智能客服、个性化推荐系统。

- 内容创作者使用:生成创意文案、新闻稿件或小说情节。

DeepSeek R1与月之暗面Kimi k1.5的对比

1. 设计与功能

- DeepSeek R1:

- 设计:基于强化学习(RL)驱动,专注于数学和代码推理。

- 功能:支持长链推理(CoT)和模型蒸馏,适用于复杂逻辑任务。

- Kimi k1.5:

- 设计:多模态思考模型,支持视觉和文本的多模态推理。

- 功能:在数学、代码和视觉任务上表现优异,适合多模态应用场景。

2. 参数与性能

- DeepSeek R1:660B参数,在AIME 2024和MATH-500上表现优于Kimi k1.5。

- Kimi k1.5:128K上下文窗口,在长文本和多模态任务上表现突出。

3. 优缺点与应用场景

- DeepSeek R1:

- 优点:推理能力强,开源生态完善。

- 缺点:对多模态任务支持有限。

- 应用场景:科研、技术开发、教育。

- Kimi k1.5:

- 优点:多模态能力强,适合复杂场景。

- 缺点:推理能力略逊于R1。

- 应用场景:视觉内容生成、多模态数据分析。

总结

DeepSeek R1的发布标志着国产AI技术的又一次重大突破。其强大的推理能力、开源生态以及高性价比的API服务,为全球开发者和企业提供了全新的选择。随着R1及其蒸馏版本的广泛应用,AI技术的普及与创新将迎来新的高潮。

责任编辑:何俊熹